本文简单总结了机器学习最常见的两个函数,logistic函数和softmax函数。首先介绍两者的定义和应用,最后对两者的联系和区别进行了总结。

2018-12-30 09:04

logistic回归是一种广义的线性回归,通过构造回归函数,利用机器学习来实现分类或者预测。 原理 上一文简单介绍了线性回归,与逻辑回归的原理是类似的。 预测函数(h)。该函数就是分类函数,用来预测

2020-09-29 15:17

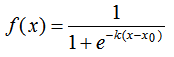

然后这些概率必须二值化才能真地进行预测。这就是 logistic 函数的任务,也称为 sigmoid 函数。Sigmoid 函数是一个 S 形曲线,它可以将任意实数值映射到介于 0 和 1 之间的值,但并不会取到 0/1。然后使用阈值分类器将 0 和 1 之间的值转换为 0 或 1。

2018-06-23 12:31

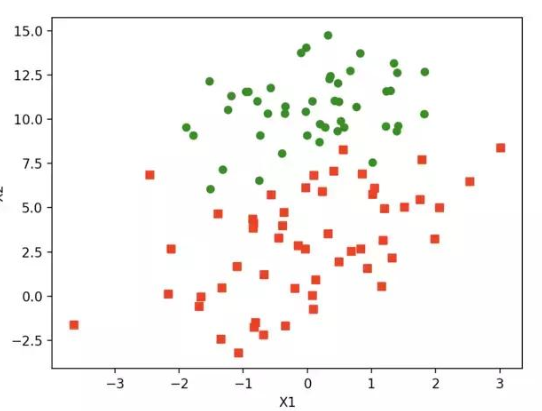

先回想一下线性回归,线性回归模型帮助我们用最简单的线性方程实现了对数据的拟合,然而,这只能完成回归任务,无法完成分类任务,那么 logistics regression 就是在线性回归的基础上添砖加瓦,构建出了一种分类模型。

2018-06-04 11:31

由第一节我们知道,熵是描述事物不确定性的指标。我们将熵的这一性质应用在信号检测领域,当信号包含了较强的随机噪声时或被噪声完全掩盖时,信号的随机性大大的增加了,其对应的熵也较大,根据这一原理对信号的质量进行检测,下图是用熵检测心电信号质量的效果图:

2019-04-13 10:45

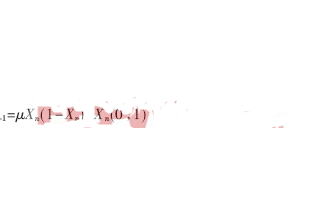

当3.569 945 6μ≤4时,Logistic映射工作处于混沌状态,即由初始条件x0在Logistic映射的作用下所产生的序列{xk}是非周期、不收敛的, 并对初始值非常敏感;当μ=4时,该映射

2020-08-10 15:55

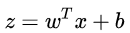

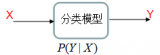

二项logistic回归模型是一种分类模型,由条件概率分布P(Y|X)表示,形式为参数化的logistic分布。这里随机变量X取值为实数,随机变量Y取值为1或0。可以通过有监督的方法来估计模型参数。

2023-10-16 10:10

Logistic回归目的是从特征学习出一个0/1分类模型,而这个模型是将特性的线性组合作为自变量,由于自变量的取值范围是负无穷到正无穷。因此,使用logistic函数(或称作sigmoid函数)将自变量映射到(0,1)上,映射后的值被认为是属于y=1的概率。

2017-12-14 14:31

的 Logistic regression 就可以认为是一个不含隐含层的输出层激活函数用 sigmoid(logistic) 的神经网络,显然 Logistic regression 就不是 deep 的。不过,现在

2018-09-06 20:48

Neural Networks The structure of the neural network A neuron can be a binary logistic regression

2020-11-02 15:32