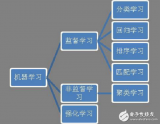

本文简单总结了机器学习最常见的两个函数,logistic函数和softmax函数。首先介绍两者的定义和应用,最后对两者的联系和区别进行了总结。

2018-12-30 09:04

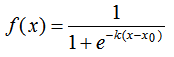

然后这些概率必须二值化才能真地进行预测。这就是 logistic 函数的任务,也称为 sigmoid 函数。Sigmoid 函数是一个 S 形曲线,它可以将任意实数值映射到介于 0 和 1 之间的值,但并不会取到 0/1。然后使用阈值分类器将 0 和 1 之间的值转换为 0 或 1。

2018-06-23 12:31

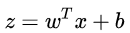

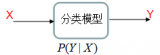

先回想一下线性回归,线性回归模型帮助我们用最简单的线性方程实现了对数据的拟合,然而,这只能完成回归任务,无法完成分类任务,那么 logistics regression 就是在线性回归的基础上添砖加瓦,构建出了一种分类模型。

2018-06-04 11:31

由第一节我们知道,熵是描述事物不确定性的指标。我们将熵的这一性质应用在信号检测领域,当信号包含了较强的随机噪声时或被噪声完全掩盖时,信号的随机性大大的增加了,其对应的熵也较大,根据这一原理对信号的质量进行检测,下图是用熵检测心电信号质量的效果图:

2019-04-13 10:45

Logistic回归目的是从特征学习出一个0/1分类模型,而这个模型是将特性的线性组合作为自变量,由于自变量的取值范围是负无穷到正无穷。因此,使用logistic函数(或称作sigmoid函数)将自变量映射到(0,1)上,映射后的值被认为是属于y=1的概率。

2017-12-14 14:31

大数据分析性能的好坏,也就是说机器学习预测的准确率,与使用的学习算法、问题的性质、数据集的特性包括数据规模、数据特征等都有关系。一般地,Ensemble方法包括Random Forest和AdaBoost、SVM、Logistic Regression 分类准确率最高。

2018-01-05 14:37

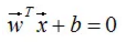

支持向量机结合了感知机和logistic回归分类思想,假设训练样本点(xi,yi)到超平面H的几何间隔为γ(γ>0),由上节定义可知,几何间隔是点到超平面最短的距离,如下图的红色直线:

2018-11-23 08:58

那么logistic回归受欢迎的原因是什么?一个迹象表明,Kaggle上的分类问题远多于回归问题,其中一个代表是这些年来最受欢迎的泰坦尼克号生存预测竞赛。这是Kaggle上历史最“悠久”的竞赛之一

2018-08-13 09:07

对于机器学习/数据科学的初学者来说,线性回归,或者Logistic回归是许多人在建立预测模型时接触的第一/第二种方法。由于这两种算法适用性极广,有些人甚至在走出校门当上数据分析师后还固执地认为回归只有这两种形式。那么事实真的是这样吗?

2018-04-27 15:55

、Logistic回归、SVM等基于统计学习理论的方法(也可以看做具有一层隐层节点或不含隐层节点的学习模型,被称为浅层模型)来说,具有较大的优越性。

2020-08-24 15:57