集成是一组协作贡献的元素。一个熟悉的例子是合奏,组合不同的乐器创建动听的和声。在集成中,最终的整体输出比任何单个部分的表现更重要。

2018-05-25 09:51

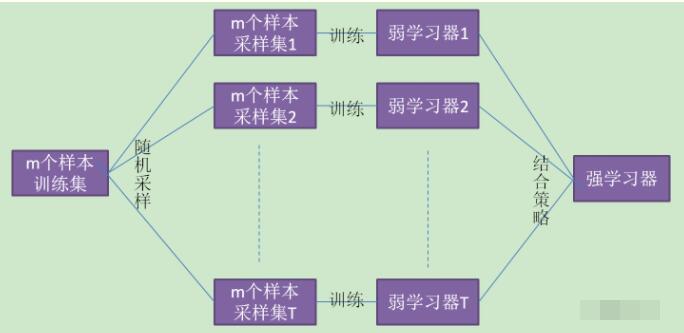

从上述问题的角度出发,集成学习分为两类流派:Bagging与Boosting。Bagging(Bootstrap Aggregating)对训练数据擦用自助采样(boostrap sampling

2018-09-23 10:02

Dropout 可以看作是 Bagging 的极限形式,每个模型都在当一种情况中训练,同时模型的每个参数都经过与其他模型共享参数,从而高度正则化。

2021-05-31 17:37

集成学习有两个流派,一个是boosting,特点是各个弱学习器之间有依赖关系;一个是bagging,特点是各个弱学习器之间没依赖关系,可以并行拟合。

2020-12-09 13:58

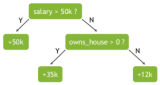

其实从直观角度来解释,每棵决策树都是一个分类器(假设现在针对的是分类问题),那么对于一个输入样本,N棵树会有N个分类结果。而随机森林集成了所有的分类投票结果,将投票次数最多的类别指定为最终的输出,这就是一种最简单的 Bagging 思想。

2023-05-15 09:46

随机森林使用名为“bagging”的技术,通过数据集和特征的随机自助抽样样本并行构建完整的决策树。虽然决策树基于一组固定的特征,而且经常过拟合,但随机性对森林的成功至关重要。

2024-03-18 14:27

投票结果,将投票次数最多的类别指定为最终的输出,这就是一种最简单的 Bagging 思想。1.5 爆发时期2006, Hinton, Deep Learning在机器学习发展分为两个部分,浅层学习

2018-07-26 15:37