word embedding 是现在自然语言处理中最常用的 word representation 的方法,常用的word embedding 是word2vec的方法,然而word2vec本质上是一个静态模型,也就是说利用word2vec训练完每个词之后,词的表示就固定了,

2019-05-02 14:32

谷歌推出BERT模型被认为是NLP新时代的开始,NLP终于找到了一种方法,可以像计算机视觉那样进行迁移学习。本文用图解的方式,生动易懂地讲解了BERT和ELMo等模型。 2018年已经成为自然语言

2019-01-03 10:21

采用了Elmo独一无二的、高级的伺服驱动技术,这家在中国机器人和自动化领域领先的公司刚刚完成第一代人机协作的工厂自动化机器人的自主研发。

2018-08-10 10:08

传统的方法,无法适应先进的数控加工技术带来的效率的提高。飞机装配技术已经制约着飞机制造业的发展。本文主要介绍了通过使用Elmo运动控制系统,借助多点成形技术实现飞机柔性数字化装配。

2019-04-26 15:29

Elmo的解决方案可以显著提高贴标机的性能,使机器产能达到60000瓶/小时。机器在超高速运行的情况下依然可以保持极高的贴标精度,这使得Elmo成为高端贴标机领域里的一个主要的方案提供商。将超过60

2019-04-05 07:21

如果自己是一个大模型的小白,第一眼看到 GPT、PaLm、LLaMA 这些单词的怪异组合会作何感想?假如再往深里入门,又看到 BERT、BART、RoBERTa、ELMo 这些奇奇怪怪的词一个接一个蹦出来,不知道作为小白的自己心里会不会抓狂?

2023-05-23 17:19

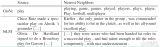

预训练是通过大量无标注的语言文本进行语言模型的训练,得到一套模型参数,利用这套参数对模型进行初始化,再根据具体任务在现有语言模型的基础上进行精调。预训练的方法在自然语言处理的分类和标记任务中,都被证明拥有更好的效果。目前,热门的预训练方法主要有三个:ELMo,OpenAI GPT和BERT。

2019-04-04 16:52