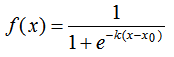

本文简单总结了机器学习最常见的两个函数,logistic函数和softmax函数。首先介绍两者的定义和应用,最后对两者的联系和区别进行了总结。

2018-12-30 09:04

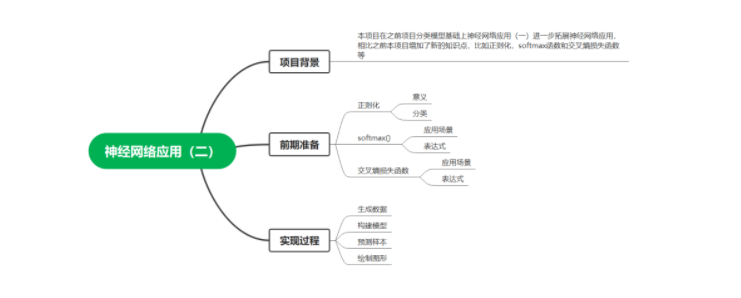

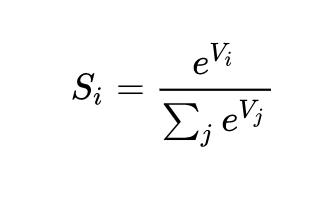

当处理一个分类问题时,使用softmax作为神经网络的最后一个激活单元是非常典型的用法。这是为什么呢?因为softmax函数接受一组logit为输入并输出离散类别上的概率分布。

2020-10-10 10:23

Temperature 是一个超参数,可用于控制生成语言模型中生成文本的随机性和创造性。它用于调整模型的softmax输出层中预测词的概率。温度参数定义为在应用 softmax 函数之前用于调整 logits 的比例

2023-05-24 17:12

本项目在之前项目分类模型基础上神经网络应用(一)进一步拓展神经网络应用,相比之前本项目增加了新的知识点,比如正则化,softmax函数和交叉熵损失函数等。

2023-02-24 15:43

Softmax在机器学习中有非常广泛的应用,但是刚刚接触机器学习的人可能对Softmax的特点以及好处并不理解,其实你了解了以后就会发现,Softmax计算简单,效果显著,非常好用。

2020-03-15 17:18

在地图上循环前进,停滞不前。运用随机梯度,智能体可以打破循环(例如向死路前进或选择可能会通向死路的道路)。神经网络包含两个隐藏层,每一层都有一个ReLU激活函数。输出使用一个softmax函数,可以返回所有行为的概率

2018-11-24 09:19

电子发烧友网站提供《PyTorch教程4.1之Softmax回归.pdf》资料免费下载

2023-06-05 15:46

商汤多模态研究组认为,近似操作本身存在的误差使得其效果很难超越Softmax Attention。我们的观点是,与其近似Softmax,不如设计一种方式代替Softmax,并且同时降低时间空间复杂度。

2022-03-30 16:18

写在前面:笔者这段时间工作太忙,身心俱疲,博客停更了一段时间,现在重新捡起来。本文主要解读 OneFlow 框架的第二种 Softmax 源码实现细节,即 block 级别的 Softmax。

2024-01-08 09:26