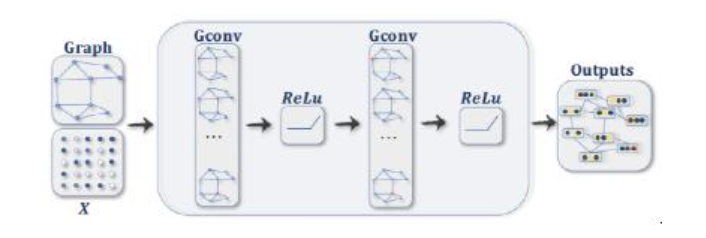

GNN的架构在宏观层面有着很多与传统CNN类似的地方,比如卷积层、Polling、激活函数、机器学习处理器(MLP)和FC层等等模块,都会在GNN中得以应用。

2020-11-11 09:26

接上一篇...... GNN加速器顶层架构 此GNN加速器是为GraphSAGE算法设计的,但是它的设计也可以应用于其他类似的GNN算法加速。其顶层架构如下图所示。 该架构由以下模块组成: 图中

2021-08-27 09:44

2019年的时针开始转动,在CNN、RNN、LSTM、GAN、GNN、CAP的潮起潮落中,带来了这篇博客。放上一篇 参考引用 。 其实个人认为理解GNN的核心问题就是理解图怎么做傅里叶变换。CNN

2019-06-08 17:13

在内容上,模型方面,本文从GNN原始模型的构建方式与存在的问题出发,介绍了对其进行不同改进的GNN变体,包括如何处理不同的图的类型、如何进行高效的信息传递以及如何加速训练过程。最后介绍了几个近年来提出的通用框架,它们总结概括了多个现有的方法,具有较强的表达能力。

2018-12-27 09:21

联邦学习和 GNN 都是当前 AI 领域的研究热点。联邦学习的多个参与方可以在不泄露原始数据的情况下,安全合规地联合训练业务模型,目前已在诸多领域取得了较好的结果。

2023-02-17 10:00

这一节讨论的是如何给图中的节点生成(或者说更新)embedding, 假设我们已经完成了GraphSAGE的训练,因此模型所有的参数(parameters)都已知了。具体来说,这些参数包括个聚合器(见下图算法第4行)中的参数

2020-11-24 09:32

GNN的架构在宏观层面有着很多与传统CNN类似的地方,比如卷积层、Polling、激活函数、机器学习处理器(MLP)和FC层等等模块,都会在GNN中得以应用。

2020-10-19 17:05

用图神经网络(GNN)做CV的研究有不少,但通常是围绕点云数据做文章,少有直接处理图像数据的。其实与CNN把一张图片看成一个网格、Transformer把图片拉直成一个序列相比,图方法更适合学习不规则和复杂物体的特征。

2022-08-16 10:21

GCN基础知识 其实有关GCN的相关基础知识在网上都查的到,后面涉及到的数学知识还是十分复杂的,这里就不详细推导每一个步骤。这里就直接给出一个最终的结论,也是Kipf and Welling在2016年 GCN领域最经典的paper《Semi-supervised classification with graph convolutional networks.》里对原始的基于拉普拉斯谱变换进行了一些简化得到最终的图卷积公式: ,其中是一个对称归一化矩阵, ,,其中是单位矩阵,是临接矩阵,是矩阵 的对角度矩阵,是第t层的中间隐层表示。即

2020-09-24 15:12

GNN 在经历过 2017-2018 年两年的孕育期与尝试期之后,在 2018 年末至今的一年多时间里,迎来了快速爆发期。

2020-02-08 18:55