2019年的时针开始转动,在CNN、RNN、LSTM、GAN、GNN、CAP的潮起潮落中,带来了这篇博客。放上一篇 参考引用 。 其实个人认为理解GNN的核心问题就是理解图怎么做傅里叶变换。CNN

2019-06-08 17:13

在内容上,模型方面,本文从GNN原始模型的构建方式与存在的问题出发,介绍了对其进行不同改进的GNN变体,包括如何处理不同的图的类型、如何进行高效的信息传递以及如何加速训练过程。最后介绍了几个近年来提出的通用框架,它们总结概括了多个现有的方法,具有较强的表达能力。

2018-12-27 09:21

用图神经网络(GNN)做CV的研究有不少,但通常是围绕点云数据做文章,少有直接处理图像数据的。其实与CNN把一张图片看成一个网格、Transformer把图片拉直成一个序列相比,图方法更适合学习不规则和复杂物体的特征。

2022-08-16 10:21

GNN 在经历过 2017-2018 年两年的孕育期与尝试期之后,在 2018 年末至今的一年多时间里,迎来了快速爆发期。

2020-02-08 18:55

本文来源:机器之心编译 作者:Zonghan Wu 图神经网络(GNN)热度持续上升,之前我们曾介绍了清华两篇综述论文,参见:深度学习时代的图模型,清华发文综述图网络,和清华大学图神经网络综述:模型

2019-01-10 10:26

即在分布式计算或者多代理(multi-agent)系统中,如何在发生进程故障的情况下保持系统的可靠性(reliability)。这通常需要进程就计算过程中的一些数值或数值操作达成一致,包括如何将提交到数据库,如何识别leader进程,状态机复制(一种故障容忍机制),原子广播等操作。

2019-07-18 10:06

作者在论文中写道:“这是一个 PyTorch 的几何深度学习扩展库,它利用专用的 CUDA 内核实现了高性能。它遵循一个简单的消息传递 API,将最近提出的大多数卷积和池化层捆绑到一个统一的框架中。所有实现的方法都支持 CPU 和 GPU 计算,并遵循一个不可变的数据流范式,该范式支持图结构随时间的动态变化。”

2019-03-11 08:49

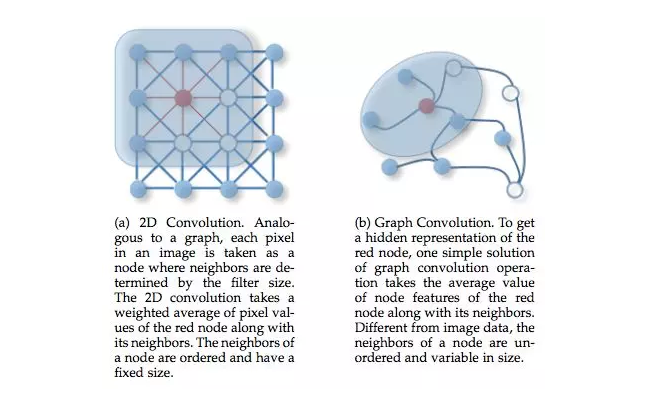

不规则域(Irregular domain)。与图像、音频、文本等具有清晰网格结构的数据不同,图处于不规则的域中,使得很难将一些基本的数学运算推广到图中。例如,卷积神经网络(CNN)中的基本操作“卷积”和“池化”,在图数据中并不能直接地定义。这通常被称为几何深度学习问题。

2019-02-04 08:46

在图分类数据集上,通过实验验证我们的理论,其中 GNN 的表达能力对于捕获图结构至关重要。特别是,我们对基于各种聚合函数的 GNN 性能进行了对比。我们的结果证实了最强大的 GNN(我们的图同构网络

2019-03-01 09:09

为了解决图的相似度学习问题,我们研究了GNN在这种情况下的使用,探讨了如何将图嵌入到向量空间中,并学习这种嵌入模型,使相似的图在向量空间中更接近,而不同的图在向量空间中距离更大。。

2019-05-08 09:40