所谓“Mini-Batch”,是指的从训练数据全集T中随机选择的一个训练数据子集合。假设训练数据集合T包含N个样本,而每个Mini-Batch的Batch Size为b,于是整个训练数据可被分成N

2018-10-19 09:19

我们知道,batch size 决定了深度学习训练过程中,完成每个 epoch 所需的时间和每次迭代(iteration)之间梯度的平滑程度。batch size 越大,训练速度则越快,内存占用更大,但收敛变慢。

2022-07-12 10:15

导读 batch normalization时的一些缺陷。 Batch Normalization确实是深度学习领域的重大突破之一,也是近年来研究人员讨论的热点之一。Batch

2020-11-03 17:27

Spring Batch 不是一个调度框架。在商业和开源领域都有许多优秀的企业调度程序(例如 Quartz、Tivoli、Control-M 等)。Spring Batch 旨在与调度程序结合使用,而不是替代调度程序。

2023-04-26 10:08

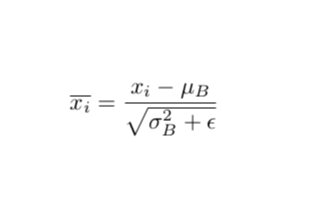

一旦训练结束,每个Batch normalization层都拥有一组特定的γ和β,还有μ和σ,后者在训练过程中使用指数加权平均值进行计算。这意味着在推理过程中,Batch normalization就像是对上一层(通常是卷积)的结果进行简单的线性转换。

2020-11-24 09:45

所以,我们该如何在限制训练速度的情况下,还可以提高batch size,同时不用维持曲率效应带来的不稳定性?答案可能是其他因素在限制学习速率,而我们并没有考虑到曲率效应。我们认为这一其他因素就是

2018-11-14 08:58

理解迭代,只需要知道乘法表或者一个计算器就可以了。迭代是 batch 需要完成一个 epoch 的次数。记住:在一个 epoch 中,batch 数和迭代数是相等

2017-10-19 12:58

Batch Normalization在2015年被谷歌提出,因为能够加速训练及减少学习率的敏感度而被广泛使用。

2019-07-19 14:52

和 DCS+Batch 系统的联动策略,另一方面介绍了 DCS 系统批次管理的优势(动态分配单元)。通过本文讲述的策略,可实现 MES 和 DCS 的同步运行,MES 可以下达生产任务给 DCS+Batch 并自动运行,在关键时间节点抓取 DCS 中的数据,将其体

2023-08-29 14:20

本文开始介绍了smt设备的概念及分析了smt设备主要是用来做什么的,其次阐述了SMT设备操作人员岗位职责,最后分析了SMT的发展前景。

2018-04-08 14:10