随着现在AI的快速发展,使用FPGA和ASIC进行推理加速的研究也越来越多,从目前的市场来说,有些公司已经有了专门做推理的ASIC,像Groq的LPU,专门针对大语言模型的推理做了优化,因此相比GPU这种通过计算平台

2024-10-29 14:12

本期Xpedition入门指南进行规则的设置,规则设置贯穿在全流程当中,比如原理图设计阶段就可以进行规则的设计,布局布线阶段可详细设计高速规则,所以要了解PCB设计流程

2022-04-29 13:35

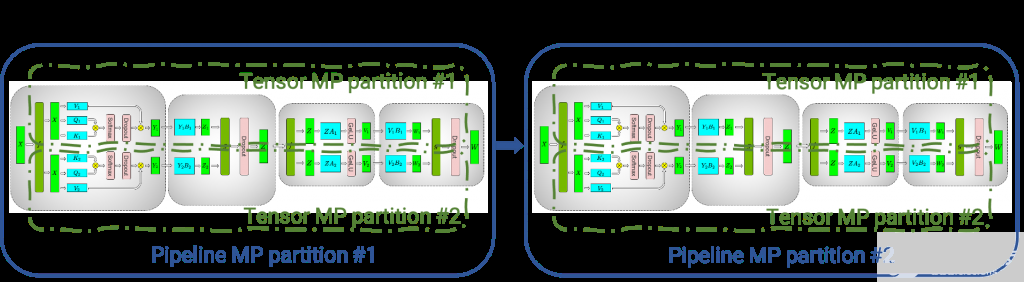

这是讨论 NVIDIA FasterTransformer 库的两部分系列的第一部分,该库是用于对任意大小(多达数万亿个参数)的Transformer进行分布式推理的最快库之一。它提供了 FasterTransformer 的概述,包括使用该库的好处。

2022-10-10 16:07

本实践中,唯品会 AI 平台与 NVIDIA 团队合作,结合 NVIDIA TensorRT 和 NVIDIA Merlin HierarchicalKV(HKV)将推理的稠密网络和热 Embedding 全置于 GPU 上进行加速,吞吐相比 CPU 推理服务提升

2024-04-20 09:39

随着大语言模型的广泛应用,模型的计算需求大幅提升,带来推理时延高、资源消耗大等挑战。

2024-11-15 14:20

具体来说,我们以多项选择的常识推理作为示例任务,因为常识推理任务是一类可能性 (plausible) 的任务,每个答案都是可能成立的,只是正确答案成立的可能性更高,所以常识推理任务更适合被用来进行辩论。

2023-11-29 15:45

OpenVINO2023版本的SDK支持同步与异步推理模式相比之前OpenVINO2021版本更加的简洁,易用。同时支持创建多个Requst然后基于多个Requst实现流水线方式的推理从而提升CPU推理的吞吐率。

2023-11-21 10:03

介绍如何在Altium Designer中导入导出设计规则,借鉴其他设计的优秀合理的规则设置(宝贵的设计经验)为我所用,而不需要自己手动创建。

2018-06-05 07:17

神经网络是否可以学习抽象推理,还是仅仅浅显地学习统计数据学习,是最近学术界辩论的主题。

2018-07-13 09:37