MAMBA SBC CABLING KIT

2023-03-29 19:54

图像复原又来新突破了!还记得性能超越SwinIR(基于Transformer)的MambaIR吗?一种基于Mamba的图像复原基准模型,登上ECCV 2024。最近原作者又开发了新版本

2024-12-30 18:09

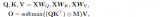

作为通用序列模型的骨干,Mamba 在语言、音频和基因组学等多种模态中都达到了 SOTA 性能。在语言建模方面,无论是预训练还是下游评估,他们的 Mamba-3B 模型都优于同等规模的 Transformer 模型,并能与两倍于其规模的 Transformer 模

2023-12-07 14:14

Vision Mamba的成功预示着将视觉表征学习转换为线性复杂度视觉序列表征学习具有巨大的潜力。尽管以Vision Mamba为代表的线性视觉序列表征学习结构在高清图像上展示了显著的效率优势,但在更为常见的分辨率,仍略逊于Transformer和CNN。

2025-01-08 09:33

本文分享香港大学计算和数据科学学院俞益洲教授及其研究团队发表于 AAAI 2025 的论文——SparX,一种强化 Vision Mamba 和 Transformer 的稀疏跳跃连接机制,性能强大

2025-01-03 09:28

MambaQuant在Mamba系列模型上实现了W8A8/W4A8量化的方法,精度逼近浮点,超过Quarot等SOTA方法。该工作已被人工智能顶会ICLR-2025接收。

2025-03-05 11:10