接着 大模型部署框架 FastLLM 简要解析 这篇文章首先梳理了一下FastLLM的调用链和关键的数据结构,然后解析了 FastLLM 的一些实现细节和CPU/GPU后端实现采用的优化技巧。

2023-07-27 10:48

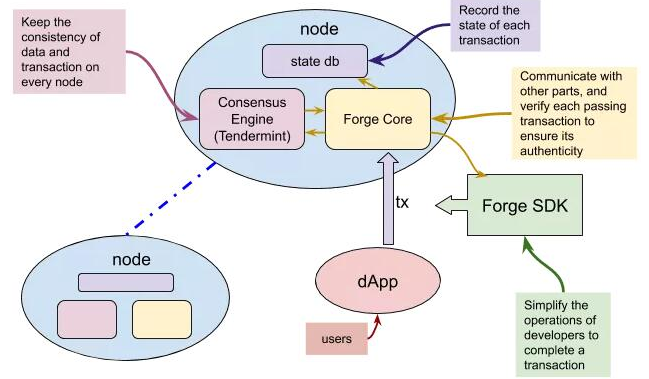

简言之,Forge 框架[2],即 Forge,是一个区块链应用开发框架,它为开发者提供了按需创建区块链和开发去中心化应用(DApps)的最简单方法。

2019-08-29 11:03

模型部署作为算法模型落地的最后一步,在人工智能产业化过程中是非常关键的步骤,而目标检测作为计算机视觉三大基础任务之一,众多的业务功能都要在检测的基础之上完成,本文提供了YOLOv5算法从0部署的实战教程,值得各位读者收藏学习。

2022-10-31 14:27

ONNXRUNTIME介绍 ONNX格式模型部署兼容性最强的框架 ONNXRUNTIME,基本上不会有算子不支持跟不兼容的情况出现,只要能导出ONNX格式模型,它基本上都能成功加载,成功推理

2023-06-19 11:50

深度学习模型部署有OpenVINO、ONNXRUNTIME、TensorRT三个主流框架,均支持Python与C++的SDK使用。对YOLOv5~YOLOv8的系列模型,均可以通过C++推理实现模型

2023-08-06 11:39

Forge 作为⼀个构建基于区块链的 dApp 框架,将大量的工作已经做好,并且提供了一套接口供应⽤程序调用。所以对于一名应用程序的开发者,只需关心自己业务逻辑,Forge 会将数据保存在区块链中供应⽤程序使⽤。

2019-09-04 11:28

ONNXRUNTIME是主流的深度学习部署框架之一,支持ONNX格式模型在CPU、GPU、ARM等不同硬件平台上加速推理,支持C++、Python、Java、C#、JS等不同语言SDK。C++版本安装包下载如下。

2023-07-13 14:46

主要是基于云服务器与分布式服务提供,企业需要支付云服务器算力费用与存储费用。优点是便于扩展,方便在多个位置与节点快速部署使用模型算法;缺点是与边缘部署相比,延时比较高,可靠性比较低,数据安全受到挑战,没有充分利用边缘设备算力。

2023-07-20 15:37

昆仑芯科技公众号全新栏目“用芯指南”重磅推出!面向AI行业技术从业者,系列好文将提供手把手的昆仑芯产品使用指南。第一期围绕昆仑芯自研效能工具——昆仑芯Anyinfer展开,这是一款基于昆仑芯AI加速卡的高效模型推理部署框架。种种行业痛点,昆仑芯Anyinfer轻松

2023-10-17 11:16

PLASTER 是一个与深度学习有关的框架,为致力于开发和部署基于 AI 的服务的人士提供了全方位指导。本文介绍了每个框架元素的测量方式,以帮助您应对诸多 AI 挑战。

2018-06-22 15:07