梯度爆炸/消失不仅仅是RNN存在的问题。由于链式法则和非线性激活函数,所有神经网络(包括前向和卷积神经网络),尤其是深度神经网络,都会出现梯度

2019-05-05 16:05

,我们可以假装“真梯度”来自某个神秘的数据集,以此训练合成梯度网络……所以我们像训练平常的网络一样训练。酷!

2018-05-14 17:32

将神经网络模型训练好之后,在输入层给定一个x,通过网络之后就能够在输出层得到特定的y,那么既然有了这么强大的模型,为什么还需要RNN(循环神经网络)呢?

2018-05-05 10:51

运用迁移学习,CNN特征,语句特征应用已有模型2. 最终的输出模型是LSTM,训练过程的参数设定:梯度上限(gradient clipping), 学习率调整(adaptivelearning)3. 训练时间很长。

2018-09-13 15:22

最近在做一个文本检测的项目,在训练的过程中遇到了很严重的梯度爆炸情况,今天就来谈谈梯度爆炸怎么解决。

2018-04-30 19:15

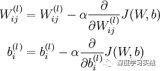

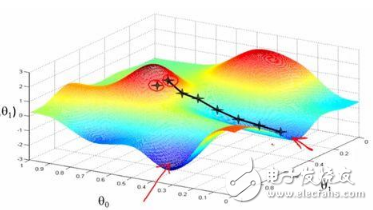

现在我们来讨论梯度下降算法的三个变种,它们之间的主要区别在于每个学习步骤中计算梯度时使用的数据量,是对每个参数更新(学习步骤)时的梯度准确性与时间复杂度的折衷考虑。

2018-05-03 15:55

RNN(Recurrent Neural Network,循环神经网络)是一种专门用于处理序列数据的神经网络结构,它能够在序列的演进方向上进行递归,并通过所有节点(循环单元)的链式连接来捕捉序列中

2024-07-04 11:48

随机梯度下降(Stochastic gradient descent) 批量梯度下降(Batch gradient descent) 梯度下降(GD)是最小化风险函数、损失函数的一种常用方法,随机

2017-11-28 04:00

循环神经网络(Recurrent Neural Network,RNN)是一种用于处理序列数据的神经网络。相比一般的神经网络来说,他能够处理序列变化的数据。比如某个单词的意思会因为上文提到的内容不同而有不同的含义,RNN就能够很好地解决这类问题。

2022-03-15 10:44