深度学习模型量化是一种重要的模型轻量化技术,旨在通过减少网络参数的比特宽度来减小

2024-07-15 11:01

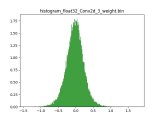

大家都知道模型是有权重 (w) 和偏置 (b) 组成,其中 w,b 都是以 float32 存储的,float32 在计算机中存储时占 32bit,int8 在计算机中存储时占 8bit;模型量化

2021-02-04 15:40

在 LLaMA, BERT 以及 ViTs 模型上,4-bit 量化皆取得了远超 SOTA 的结果。特别是,这篇文章展示了 4-bit 量化的 LLaMA-13B 模型

2023-11-24 11:15

近日,Meta在开源Llama 3.2的1B与3B模型后,再次为人工智能领域带来了新进展。10月24日,Meta正式推出了这两个模型的量化版本,旨在进一步优化

2024-10-29 11:05

深度神经网络模型量化是深度学习领域中的一种重要优化技术,旨在通过减少模型参数的精度(即从高精度浮点数如32位浮点数FP32降低到低精度整数如8位整数INT8或更低)来降

2024-07-15 11:26

深度学习模型量化支持深度学习模型部署框架支持的一种轻量化模型与加速

2023-07-18 09:34

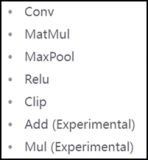

MNN 是一个轻量级的深度学习端侧推理引擎,核心解决深度神经网络模型在端侧推理运行问题,涵盖深度神经网络模型的优化、转换和推理。目...

2020-12-10 18:14

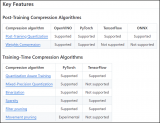

OpenVINO2023版本衍生出了一个新支持工具包NNCF(Neural Network Compression Framework – 神经网络压缩框架),通过对OpenVINO IR格式模型的压缩与量化更好的提

2023-11-20 10:46