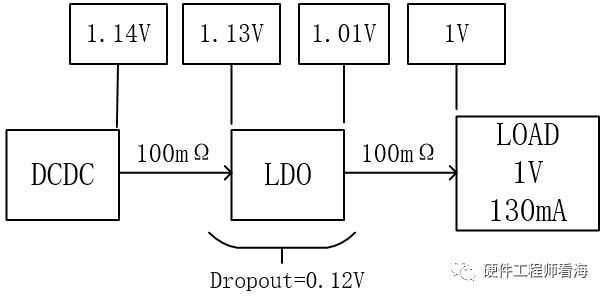

原文来自公众号:硬件工程师看海 后台回复:LDO仿真文件 LDO是我们常用的电源解决方案,dropout voltage(压差)是LDO最常见的参数之一,但是并不是所有的工程师都能够正确的设计LDO

2021-04-30 09:55

如之前所说,Dropout需要将每层的隐藏单元在Bernoulli过程中删除。如果我们在同样的网络中,将Dropout和SDR进行对比,可以发现二者的不同在于随机处理是否影响了权重或隐藏单元。图2我们描述了Dropout

2018-08-15 08:32

Dropout是指在深度学习网络的训练过程中,对于神经网络单元,按照一定的概率将其暂时从网络中丢弃。

2019-08-08 10:35

Dropout是在《ImageNet Classification with Deep Convolutional》这篇论文里提出来为了防止神经网络的过拟合。它的主要思想是让隐藏层的节点在每次迭代时(包括正向和反向传播)有一定几率(keep-prob)失效。

2020-01-28 17:44

几乎所有目前最先进的神经网络都用到了dropout. 这篇教程介绍如何通过几行Python代码在神经网络中加入Dropout. 读完这篇教程之后,你将得到一个可以工作的dropout实现,并且掌握在任何神经网络中加入

2018-04-15 09:59

线性电源LDO基础知识(一):压降Dropout Voltage

2023-05-06 14:07

一个很著名的方法——dropout. 废话少说,咱们单刀直入正题。究竟啥是 dropout ? dropout 是指在神经网络训练的过程中,对所有神经元按照一定的概率进行消除的处理方式。在

2018-08-24 18:31

Dropout 可以看作是 Bagging 的极限形式,每个模型都在当一种情况中训练,同时模型的每个参数都经过与其他模型共享参数,从而高度正则化。

2021-05-31 17:37

dropout是指在深度学习网络的训练过程中,对于神经网络单元,按照一定的概率将其暂时从网络中丢弃。注意是暂时,对于随机梯度下降来说,由于是随机丢弃,故而每一个mini-batch都在训练不同的网络

2017-11-16 01:11

他们首先通过对梯度范数的有趣观察来研究 dropout 的训练动态,然后得出了一个关键的实证发现:在训练初始阶段,dropout 降低小批量的梯度方差,并允许模型在更一致的方向上更新。这些方向也更与整个数据集的梯度方向保持一致,具体如下图 1 所示。

2023-03-13 10:15