本周论文包括尤洋团队FastFold上线,训练时间从11天压缩至67小时;微软亚洲研究院直接把 Transformer 深度提升到 1000 层等研究。

2022-03-24 14:22

美国国家标准技术研究院把非接触式光学测量仪器连接在一个基于互联网的MEMS计算器上。利用简单有效的光学干涉仪。这个方法使得工程师在光学干涉仪中插入测量值,从而确定其标准的机械性能。

2019-04-04 13:44

资源利用率,节省硬件投入成本,奇虎360系统部大数据团队与人工智能研究院联合开发了深度学习调度平台——XLearning。

2018-01-02 15:24

我们将网络的核心命名为”CP模块“,其结构如下,大致分为两个部分。输入和输出都是一个THW x C的视频表征张量,我们将这两者都视为一个THW个点的带C维特征向量的点云。

2019-05-25 09:41

本篇分析来自科大讯飞技术团队,深度解析了DeepSeek-V3 / R1 推理系统成本,旨在助力开发者实现高性价比的MoE集群部署方案。感谢讯飞研究院副院长&AI工程院常务副

2025-04-15 13:46

该模型翻译精度更加接近 AT 模型,在 WMT16 En-Ro 数据集上,相比 AT 模型(Transformer)仅有 1 个 BLEU 分的差距。在翻译速度方面,相比 AT 模型(Transformer)最高有 25 倍的翻译速度提升;相比 NAT 模型(LT、NART、IR-NAT)也有速度上的提升。

2019-01-28 09:08

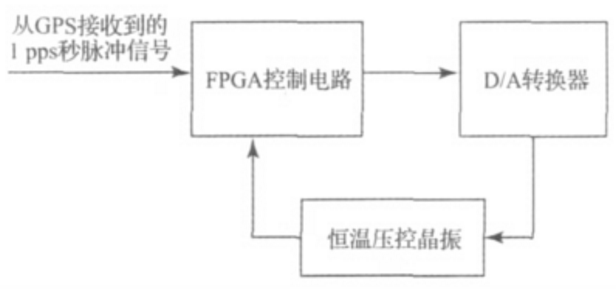

本文主要介绍了基于FPGA的压控晶振同步频率控制系统的研究与设计。利用GPS提供的1pps秒脉冲信号,为解决上述问题,在FPGA的基础上利用干扰秒脉冲信号消除和偏差频率平均运算等方法,减少外围电路

2018-03-02 14:55

为了弥补空间精度的损失,研究者们在分类卷积神经网络结构的基础上,通过引入上采样操作和/或组合空洞卷积减少降采样次数来提升表征的分辨率,典型的结构包括Hourglass、U-Net等(如图2)。

2019-05-25 10:43

3月4日,中国信息通信研究院院长刘多表示,5G第一版国际标准将于今年6月完成。

2018-03-05 10:00

它是基于另一个基于注意力的卷积TTS模型——Deep Voice 3创建的。Deep Voice 3能够将文本特征(例如字符、音素、强调等)转换成波谱特征(例如log-mel声谱和log-linear声谱)。这些波普特征可以输入到训练波形合成的模型中,例如WaveNet。相反,我们直接将从注意力机制中学习到的隐藏表示输入到神经语音编码器中,用端到端的方式从零训练整个模型。

2018-07-26 09:12