单精度矩阵乘法(SGEMM)几乎是每一位学习 CUDA 的同学绕不开的案例,这个经典的计算密集型案例可以很好地展示 GPU 编程中常用的优化技巧。本文将详细介绍 CUDA SGEMM 的优化手段

2022-09-28 09:46

本篇文章是GEMM优化的第一个部分,在这篇文章中,只说优化思路和分析。

2023-05-25 09:03

首先,编写一个矩阵乘法程序(matrix multiplication program)。

2024-02-21 16:06

TensorCore改进的方向就是针对矩阵乘法(GEMM,General Matrix Mulitiplicaiton)运算进行优化。

2022-12-29 09:24

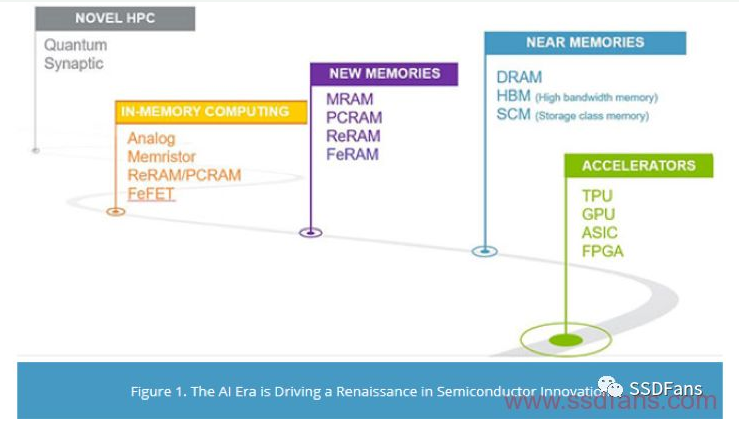

AI时代结构设计的变化影响了逻辑和存储。机器学习算法大量使用了矩阵乘法运算,而这些运算在通用逻辑中十分繁琐,这推动了加速器及存储器的发展。

2019-12-31 16:14

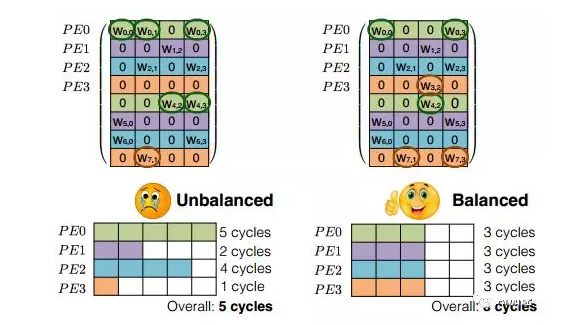

Long-short term memory,简称LSTM,被广泛的应用于语音识别、机器翻译、手写识别等。LSTM涉及到大量的矩阵乘法和向量乘法运算,会消耗大量的FPGA计算资源和带宽。为了实现硬件加速,提出了稀疏L

2019-08-24 10:32

如果你像我一样,发现记住PyTorch/TensorFlow中那些计算点积、外积、转置、矩阵-向量乘法、矩阵-矩阵乘法的

2018-10-04 08:50

我们可以将数据集加载到张量中,并使用基本的数学运算来操纵这些张量。要开始构建复杂的模型,我们还需要一些线性代数工具。本节简要介绍了最基本的概念,从标量算术开始,一直到矩阵乘法。 火炬网路网贾克斯张量流import torch

2023-06-05 15:15

而当你真正触达到更底层的TensorFlow代码时,同时你也获得了随之而来的最具有挑战性的部分:你需要确保所有矩阵乘法都排成一行。哦对了,甚至别指望打印出图层的一个输出,因为你只会在终端上打印出一个漂亮的Tensor定义。

2019-06-29 09:20

例如NeuPro AI处理器包括专用的引擎处理矩阵乘法、完全连接层、激活层和汇聚层。这种先进的专用AI引擎结合完全可编程工作的NeuPro VPU,可以支持所有其它层类型和神经网络拓扑。这些模块之间

2018-06-01 10:43